黄同学2021-11-14 00:26:56

黄同学2021-11-14 00:26:56

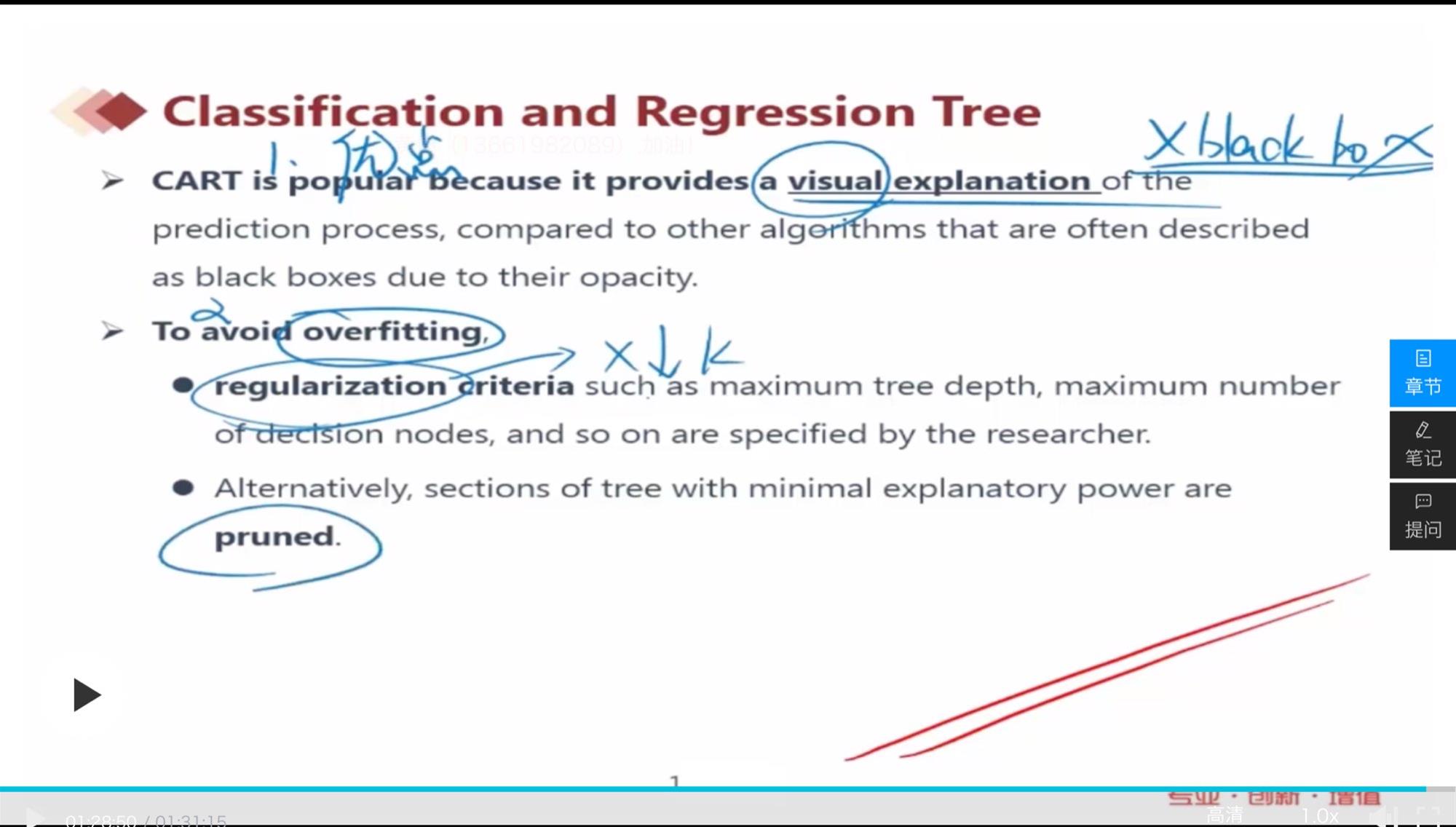

老师,这里regularization的英文解释是最大化decision nodes的数量,但是视频里老师说要减少x的数量,讲义上的解释是和课上讲的有矛盾吗?

回答(1)

Essie2021-11-15 10:37:23

Essie2021-11-15 10:37:23

你好,这里没有矛盾。

因为CART不对训练数据的特征做任何假设,因此如果不受约束,它可能会完美的学习训练数据,所以讲义上写的是:为了避免这种过拟合,可以添加正则化参数,例如提前设置数的最大深度,决策节点的最大数量或者其他的参数,这些参数就会限制决策树的过度学习,从而避免了过拟合。

而老师说的降低自变量的个数可以算另一种避免过拟合的方式,同一个feature在不同的节点反复使用,实际上就简化了模型的难度,过度复杂的模型也可能会带来过拟合的问题,而较简单的模型则不太会有这种问题。

如果我的回答有帮助到你的话,请点赞支持一下我们,加油;)

- 评论(0)

- 追问(0)

评论

0/1000

追答

0/1000

+上传图片